調べようと思って、AIに聞く。

返ってきた答えを読んで「なるほど」と思い、次に進む。 特に違和感はなかった。

でも思い返してみてください。あなたは、その時、何かを考えましたか? プロンプトは考えたかもしれません。でも、AIの回答に対しては、どうだったでしょうか。

便利だから使う。それは当然のことです。ただ、「便利だから使う」が積み重なったとき、どこかで「自分で考える」という作業が、少しずつ外注されていきます。

不便になっているわけではありません。むしろ、すべてがスムーズに進んでいきます。だからこそ、気づきにくい。

この記事では、AIを使いながら自分の考える力を手放さないための、具体的な習慣についてお伝えします。

「AIを使わないようにしましょう」という話ではありません。

使い方を意識的に設計することで、道具との関係は大きく変わります。

AIは「答え」を出せるが、「考えること」までは代行はできない

現在の生成AIが得意とするのは、大量の情報を処理して提示することです。複数の情報を組み合わせ、特定の形式でまとめ、文体を整える作業においては、人間よりもはるかに速く処理できます。

使わない理由はありません。

ただ、AIには明確に苦手なことがあります。この特性を把握せずに使い続けると、「答えが出た」という感覚だけが積み重なり、「その答えを自分はどう評価するか」という思考のステップが、自然と省略されていきます。

AIが得意なこととそうでないことを理解することが、道具たるAIとの適切な関係を保つ出発点になります。

正確性の保証ができない──ハルシネーションという構造的な問題

生成AIは、大量のテキストデータを学習し、入力に対して「次に来るべき言葉」を確率的に予測して文章を生成します。これは、事実を検索して返すシステムとは根本的に異なるしくみです。

このため、AIは「正確な情報を提供する」ことではなく、「それらしい文章を生成する」ことを目的として動作しています。結果として、存在しない人物名・論文タイトル・統計数値・歴史的事実などが、流暢な文章の中に紛れ込む形で出力されることがあります。これが「ハルシネーション(幻覚)」と呼ばれる現象で、現在の生成AI全般に共通する構造的な問題として広く認識されています。特定のサービスの欠陥ではなく、現時点における生成AIという技術そのものの性質です。

特に注意が必要なのは「もっともらしい嘘」です。完全に荒唐無稽(こうとうむけい)な内容であれば気づきやすいですが、AIのハルシネーションは多くの場合、文脈として不自然なわけではなく、読んでも違和感を覚えにくい形で現れます。専門的な内容ほど受け取る側も確認しにくく、そのまま信じ込まれやすい傾向があります。

AIを便利に使い続けるうえで、この問題は最初に知っておくべきことのひとつです。

文脈の把握と判断は、AIには委ねられない

あなたが今なぜその疑問を持っているのか、どんな経緯でその作業をしているのか、何を本当に必要としているのか。AIは与えられた入力の範囲でしか応答できず、その背景を自発的に読み取ることはできません。

そして、何かを選ぶ、優先順位をつける、自分の状況にとって何が重要かを決めるという作業は、あなたの価値観・経験・目的と切り離すことはできません。

当然のことかもしれませんが、AIは選択肢は提示できますが、「これがあなたにとって正解だ」と判断することはできないのです。

これらの特性を知らずにAIを使い続けると、「答えが出た」という感覚だけが積み重なり、「その答えは信頼できるか」「自分の状況に本当に合っているか」と立ち止まる回路が育たなくなっていきます。

AIが得意なことと、今も人間がやるべき部分の境界線を知っておくことが、思考力を維持しながら道具を活かすための第一歩です。

「記憶しなくていい」の積み重ねが、思考の材料を細らせていく

2011年、コロンビア大学の心理学者ベッツィー・スパロウらの研究チームが、インターネットへの日常的なアクセスが記憶に与える影響を調べた研究を発表しました(Sparrow et al., 2011, Science誌)。

この研究で確認されたのは、「後で検索できると思っている場合、その情報を記憶しにくくなる」という傾向です。人は情報の中身そのものよりも、「どこに行けばその情報が手に入るか」という場所の情報を優先して記憶するようになる、というのが研究チームの見解でした。この現象は「グーグル効果(Google Effect)」と呼ばれています。

AIの普及は、この傾向をさらに強める可能性があります。

検索して情報を探す手間さえなく、まとめて提示してもらえるなら、「後で確認すればいい」という感覚はより強まります。

「考える」とは、頭の中に蓄積された知識・経験・記憶を組み合わせて、新しい見方や判断を生み出すことです。その材料となる知識が「どこかで見られるから手元になくていい」という形でしか持たれなくなると、いざ自分の頭だけで何かを考えようとしたとき、素材が乏しい状態が生まれやすくなります。

これはAIを使うことへの否定ではありません。「記憶しなくていい」「考えなくていい」という感覚に無自覚なまま流されると、思考の土台が少しずつ薄くなっていく可能性を知っておくことに意味があります。

スマホやAIによって思考力が崩れていくプロセスについて、もう少し深く知りたい方はこちらもご参照ください。

AIとの距離を、自分で設計する

便利さに引っ張られる形で使い続けると、「どこまでが自分の思考で、どこからがAIの出力なのか」が少しずつ曖昧になっていきます。

ここでは、AIを使いながら思考の回路を維持するための、具体的な習慣を紹介します。どれも特別な能力を必要とするものではありません。日々の使い方にひと手間を加えるだけで、AIとの関係は変わっていきます。

使う前に「自分はどう思うか」を先に出す

何かをAIに聞こうと思ったとき、その前に30秒だけ「自分はどう思うか」「今わかっていることは何か」「何が不明なのか」を頭の中で確認してみることです。

このひと手間によって、AIに投げかける質問自体の精度が上がります。自分が何を求めているかが明確になるほど、回答もより的確になります。そして、AIの回答を受け取ったときに「自分の考えと合っているか」「違う部分はどこか」という比較が生まれ、受動的な受け取りではなく能動的な咀嚼になります。

認知心理学者のジョン・スウェラーが1988年に提唱した認知負荷理論(Cognitive Load Theory)では、「処理の負荷が高すぎても低すぎても、深い理解は生まれにくい」という原則が示されています。AIが即座に答えを出してくれる環境は、処理の負荷がほぼゼロになる状態です。その状態が続くと、自分で考えることへの耐性が低下していきます。AIに聞く前に自分の考えを先に出すことは、その負荷をあえて自分に残すということでもあります。

最初は面倒に感じるかもしれませんが、この習慣は「AIを補助として使う」状態を保つための、最も手軽な方法です。

出力を「答え」ではなく「素材」として受け取る

AIの出力をそのまま使うのではなく、「素材として受け取り、自分の言葉で再構成する」という使い方が、思考力を保ちながらAIを活用する最も実践的な方法のひとつです。

たとえば、AIに文章の骨格を出してもらったとします。そのまま使うのではなく、「この順序は自分の意図に合っているか」「この表現は自分の感覚と一致しているか」「抜けている視点はないか」を確かめながら、自分の手で書き直す。この過程に、思考が生まれます。

アイデア出しでも同様です。AIが10個の案を出してきたとき、「どれが自分の状況に合っているか」「これらにないアイデアが自分には浮かぶか」と考える時間が、創造的な思考の訓練になります。

さらに、AIを使って調べたことや学んだことを、後から自分の言葉でノートに書き直してみることも効果的です。AIの文章をコピーするのではなく、自分が理解した内容を自分の言葉で再現する。この過程で「実は理解できていなかった部分」が浮かび上がってきます。わからなかった部分が見えることが、次の学習へと繋がります。

AIの出力を「答え」として受け取るか「素材」として受け取るかは、使い方次第です。

その意識を持てているかどうかで、AIとの関係は大きく変わります。

意図的にAIを使わない場面をつくる

AIを「使わない場面」を意図的に設けることも思考力を維持するために効果的な方法です。

日常的な文章を書くとき——メールの返信、簡単なメモ、日記、短い報告書。こうした文章をAIに書かせることは技術的には可能ですし、既に多くの方が行っているかと思われます。ですが、自分で書く過程にこそ思考が宿ります。何を伝えるか、どの順序で書くか、どの言葉を選ぶか。この小さな判断の積み重ねが、言語的な思考力を維持します。

また、何か新しいことを学ぶとき。まずAIに説明させるのではなく、自分で読み、自分で理解しようとする時間を先に設けることで、知識は記憶に定着しやすくなります。スパロウらの研究が示したように、「調べればわかる」という前提のもとで読んだ情報は記憶に残りにくい傾向があります。

そのため、自分の頭で理解しようとする姿勢が、学習の質を変えます。

「AIを使わない」ことが目的ではありません。「ここは自分でやる」という判断を意識的に持てているかどうかが、大切な点です。

情報の出所を確認することが、ハルシネーションへの唯一の対策になる

AIとの付き合い方において、最も重要な習慣のひとつが、情報の出所の確認です。

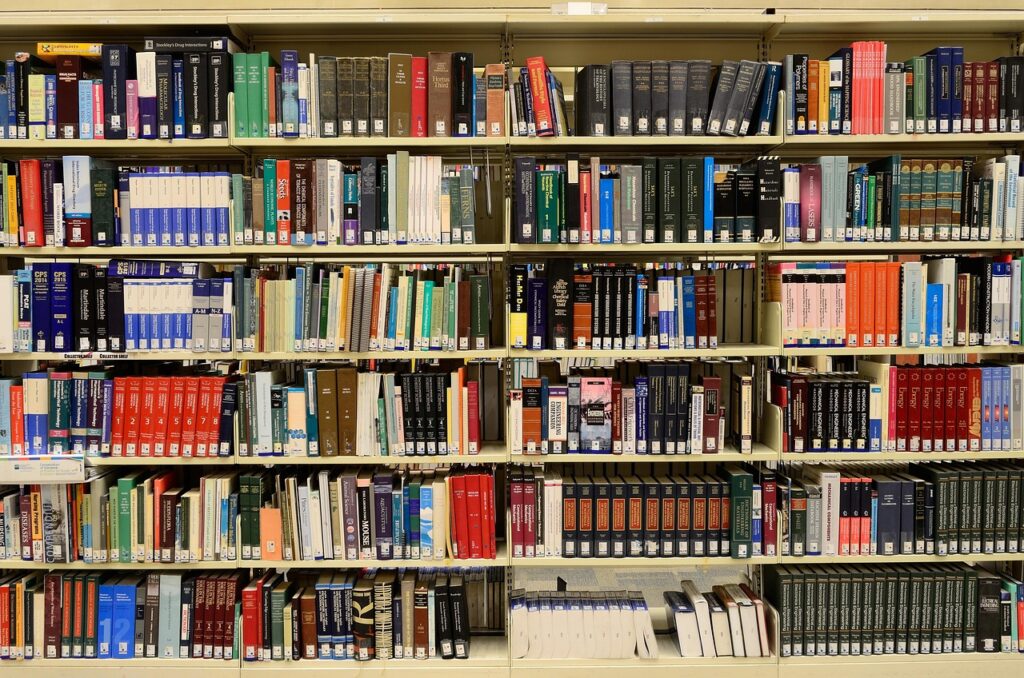

司書の業務のひとつに、レファレンスサービスというものがあります。利用者から「この情報を調べてほしい」という依頼を受け、目的の資料や情報を探し出して提供する仕事です。このとき、情報の出所を確認することは基本中の基本です。「どの資料に書かれているか」「その著者は誰か」「いつ書かれたものか」「原典(一次資料)なのか、それを引用した二次資料なのか」——これらを確かめずに情報を提供することは、司書の仕事としてあってはなりません。

AIの回答には、この確認作業が含まれていません。AIは情報を生成しますが、その出所を保証しません。だからこそ、使う側がこの確認を担う必要があります。

疑うべき場面を知っておく

AIの回答を確認すべき場面には、共通したパターンがあります。

数字・統計が含まれているとき。 AIが「○○%」「○○人」「○○年」という具体的な数字を提示した場合、その出所を確認することが必要です。数字は正確に見えるほど信頼されやすく、同時に誤りを含みやすい要素でもあります。

論文・研究・著者名が引用されているとき。 著者名・大学名・掲載誌名・発表年度がセットで示されていても、それがそのまま実在するとは限りません。Google ScholarやPubMedで著者名と論文タイトルを検索し、実際にヒットするかを確認してください。

「○○が証明されている」「研究で示されている」という断言があるとき。 根拠となる研究の出所が示されていない場合は、その断言を一旦保留にすることが賢明です。「研究によると」という表現は、具体的な出所のない場合に多用される傾向があります。

自分がほとんど知らない専門領域についての回答のとき。 知識がない領域では誤りに気づきにくいため、特に慎重な確認が必要です。専門家の文献や公的機関の情報を当たることを習慣にしてください。

確認の具体的な手順

確認の手順は、以下の三段階が基本です。

まず、AIの回答に登場するキーワードで一次資料(論文・公的統計・政府機関のサイト)を検索します。次に、複数の信頼できる情報源で同じ内容が確認できるかを見ます。そして、確認できなかった情報は「不確実」として扱い、使用を控えるか表現を弱めます。

これは面倒に思えるかもしれませんが、「出所を確認しない情報は情報ではない」という原則は、AIの時代においても変わりません。「AIが言っていたから」を根拠にした情報は、その時点でまだ確認されていない情報です。確認して初めて、使える情報になります。

情報を扱う仕事においては、この確認の手間を省くことが、最終的に最も大きなリスクになります。AIを使うとは、この確認の責任を自分に引き受けることでもある——その意識が、AIを使いこなすための土台になります。

自分の言葉を、持ち続けるために

AIが日常に溶け込んだ今、「自分の言葉」を持ち続けることは、以前より意識的な選択を必要とするようになりました。

答えはすぐに手に入ります。情報はまとめてもらえます。文章も、方向性さえ示せば仕上げてもらえます。その便利さの中で、「これは自分が考えたことだ」と言えるものがどれだけあるか、と立ち止まることは、今の時代においてはとても珍しくなっています。

この記事でお伝えした習慣——AIを使う前に自分の考えを先に出すこと、出力を素材として自分の言葉で再構成すること、情報の出所を確認すること、意図的にAIを使わない場面をつくること——はどれも、特別な能力を必要としません。ただ、意識を向けるかどうかだけの違いです。

情報を扱う仕事をしてきた立場から言えば、情報は「受け取るもの」ではなく「扱うもの」です。AIが提示した情報を、確認し、評価し、自分の文脈に位置づける。その一連の作業を自分の手に持ち続けることが、どれだけ便利な道具が増えても変わらない、情報と向き合う姿勢の核心だと思っています。

どの作業をAIに任せるか。どの作業を自分でやるか。AIの回答をどの段階で確認するか。自分の考えをいつ先に出すか。こうした判断を意識的に持てているとき、AIは「使いこなしている道具」になります。判断なしに使い続けるとき、AIは「慣れた習慣」になり、どこまでが自分の思考でどこからがAIの出力なのかが、少しずつ曖昧になっていきます。

あなたが最後に「自分の言葉で」何かを語った瞬間を、思い出せますか?

誰かに教えてもらったことではなく、調べてそのまま出したことでもなく、自分の頭の中で何かが結びついて、初めて言えた言葉。それはどんな場面で生まれましたか?

AIは、その瞬間を奪うものではありません。

ただ、設計なしに使い続けていると、そういう瞬間が訪れる機会は確実に減っていきます。思考力とは、大げさなものではなく、こうした日々の小さな積み重ねの中に宿るものです。

AIに聞く前に、一度立ち止まる。それだけでいいのです。

その小さな習慣の積み重ねが、自分の言葉を守り続けるための、最初の一歩になります。

.webp)