私たちは、AI技術の発達により多くの恩恵を受けています。しかしながら、思考力や創造性の低下、人間らしさの喪失など、AIに過度に依存し続けることで、さまざまな危険性が指摘されています。この記事では、AIとの上手な付き合い方や人間の本質的な力を維持するためのポイントについて解説します。(ここでのAIとは主に生成AIを指します。)

AI依存が引き起こす危険性とは

近年、AI技術は急速に進化し、私たちの日常生活やビジネス環境に多大な影響を及ぼしています。しかし、この進歩に伴って、「過度な依存」という新たな問題も浮かび上がっています。AIが提供する便利さに甘んじてしまうことで、我々は自らの能力を損なう危険性に曝されているのです。

自律的思考の喪失

AIに依存することで、人間自身の思考力や問題解決能力を低下させると考えられています。特に以下のような理由から注意が必要です。

- 判断の委譲:人がAIの助けを求め、常にその意見や結果に頼るようになると、自分で考える機会が失われます。その結果、特に批判的思考力(クリティカルシンキング能力)が大きく退化する恐れがあります。

- 自立性の欠如:重要な決定をAIに任せることで、自分で選択するという責任が薄れ、自己決定力が衰退します。

スキルの陳腐化

業務の効率化や自動化の一環としてAIを利用することは非常に良いことですが、それが結果的に求められるスキルの急激な変化を引き起こすことになります。

例えば、

- 必要な専門知識の減少:自動化されたプロセスに頼ることで、必要な専門知識や技術を習得する機会が減少し、新たな変化への適応力が損なわれてしまいます。

- 創造性の低下:AIによる解決策が用意されることで、自らの創造性や独自のアイデアを活かす場面が大きく減少します。これにより、イノベーションやヒラメキが発生しにくくなります。

誤情報の拡散と判断力の低下

AIは膨大なデータをもとに情報を提供しますが、その情報が必ずしも正確とは限りません。AIを過信することで、人間の判断力が低下し、誤った情報に振り回されるリスクが高まります。

- フェイクニュースの拡散:AI生成コンテンツの急増により、誤情報が拡散しやすくなっています。AIが提供する情報を鵜呑みにすることで、正しい情報を見極める力が衰えてしまいます。

- 批判的思考の喪失:AIの回答をそのまま受け入れることで、疑問を持つ習慣が減少し、主体的に調査・考察する力が低下します。

人間関係の希薄化

AIの普及により、コミュニケーションの多くが自動化されることで、人間同士のつながりが希薄になる可能性があります。

- 対面コミュニケーションの減少:AIアシスタントやチャットボットの活用が進むことで、直接的な会話の機会が減り、人間関係の構築が難しくなる恐れがあります。

- 共感力の低下:AIは論理的な回答を提供できますが、感情や共感に基づくやり取りは不得意です。その結果、人間同士の相互理解や共感力が低下する可能性があります。

セキュリティリスクの増大

AIに依存しすぎることで、個人情報や機密データの管理が甘くなり、セキュリティリスクが増大します。

- プライバシーの侵害:AIアシスタントや自動化ツールに個人情報を入力することで、意図せず機密情報が漏洩するリスクが高まります。

- サイバー攻撃の標的化:AIに依存するシステムが増えるほど、ハッキングやデータ改ざんのリスクが高まり、AIの誤作動による被害が発生する可能性があります。

AIバイアスによる偏った判断

AIは学習データに基づいて判断を行いますが、そのデータが偏っていると、結果として差別的・不公平な判断をすることがあります。

- アルゴリズムの偏見:AIの学習データにバイアスが含まれている場合、誤った先入観を助長する結果になりかねません。

- 多様性の欠如:AIが提供する情報や推奨が一定の傾向に偏ることで、新しい視点や価値観に触れる機会が減少し、思考の幅が狭まる恐れがあります。

AIへの過度な依存には様々なリスクが潜んでいます。我々は、AIの利便性の恩恵を享受しつつも、同時に自己の能力を磨く努力を怠らず、人間らしい判断力と思考力を育てていく必要があります。

過信がもたらす思考力と創造性の低下

現代社会において、AI技術は私たちの生活に大きく影響を与えています。その利便性から、私たちはAIを多くの場面で利用するようになりましたが、その反面、思考力や創造性が低下するリスクが浮き彫りになってきています。このセクションでは、AI過信による具体的な影響について考察します。

AI依存のメカニズム

AIに過度に依存することで、思考プロセスが省略される傾向があります。以下は、そのメカニズムです。

- 情報の即時性:AIが瞬時に情報を提示するため、私たちは自ら考える必要がなくなります。

- 選択の簡素化:AIが推奨する選択肢をそのまま受け入れることで、意思決定のプロセスが単純化されます。

- 認知負荷の軽減:思考せずに済むため、精神的な疲労が軽減される一方で、長期的な思考力が低下してしまいます。

思考力・創造性への影響

AIへの過信は、創造性にも深刻な影響を及ぼします。AIが提供する情報やアイデアを思考停止状態で受け入れることで、以下のような問題が生じます。

- 独自性の欠如:他者の意見やAIの提案に依存し、自分自身の意見を持たなくなります。その結果、独自の視点が欠如してしまいます。

- 想像力の退化:答えがAIによって提供されることが当たり前となり、自ら想像する機会が失われ、問題解決のための新たなアプローチを考える力が鈍ります。

- 反応としての思考:AIに依存することで、与えられた情報に対して定型的な反応を示す傾向が高まり、創造的思考を促進する機会を逃してしまいます。ユーモアが無くなってしまう、ということですね。

批判的思考の衰退

AIの回答をそのまま受け入れることで、自ら情報を精査し、論理的に考える機会が減少してしまいます。

- 誤情報の見極めが困難に:AIは膨大なデータをもとに回答を生成しますが、その内容が必ずしも正確とは限りません。情報を精査せずに信じる習慣がつくと、誤った知識を蓄積してしまう危険性があります。

- データに基づく判断の低下:AIが出した結論を妄信することで、自ら調査し、複数の視点を考慮する習慣が薄れます。結果として、論理的思考や多角的な視野を持つ力が衰えてしまいます。

- 質問力の低下:良質な思考を生み出すには、適切な問いを立てることが不可欠ですが、AIに頼りすぎると「どう問いを立てればよいのか」が分からなくなってしまう恐れがあります。

創造的挑戦への意欲低下

創造的な仕事や新しいアイデアを生み出す際には、不確実性を受け入れ、試行錯誤を重ねることが重要です。しかし、AIを過信することで、このプロセスを省略しようとする傾向が強まります。

- 試行錯誤の回避:AIがすぐに答えを出すことで、自分で仮説を立てて試し、修正しながら答えを導くプロセスが疎かになります。これにより、学習機会が減少し、創造的な思考を育む機会を失ってしまいます。

- 既存アイデアの焼き直し:AIが生成するアイデアは、基本的に既存の情報に基づいています。そのため、ユーザーがAIの提案をそのまま受け入れてしまうと、オリジナリティが失われ、新たな価値を生み出す機会が減少します。

- アイデアの深掘りの不足:AIの提案を表面的に利用するだけでは、物事を深く掘り下げる習慣が失われ、独創的な発想を生む力が低下します。

感性や直感の鈍化

人間は、論理的な思考だけでなく、直感や感性を活かして創造性を発揮します。しかし、AI依存が進むことで、こうした能力が弱まる可能性があります。

- 感覚的な判断の軽視:AIはデータやロジックに基づいた提案をしますが、人間が持つ「直感的なひらめき」や「経験に基づいた判断」は考慮されません。結果として、感覚を頼りにする判断力が衰え、個性的な発想が減ってしまいます。

- 芸術的感性の低下:創作活動(文章執筆、デザイン、音楽など)においても、AIが自動生成するコンテンツに頼りすぎると、自らの感性を鍛える機会が失われ、独自のスタイルや表現力が損なわれる可能性があります。

- 人間らしいひらめきが失われる:直感的なひらめきは、偶然の発見や多様な経験から生まれます。AIを使うことで効率が向上する一方で、こうした「偶然の価値」に触れる機会が減り、インスピレーションが得にくくなります。

AIに依存しすぎないための対策

AIの利便性を享受しつつ、思考力や創造性を維持するためには、適切な使い方を意識することが重要です。

- AIを「補助ツール」として使う:AIを意思決定の主体ではなく、あくまでサポート役として活用することを意識することで、自らの思考力を維持できます。

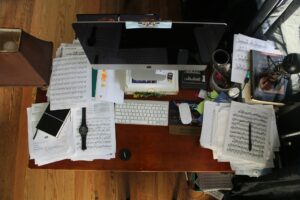

- 手書きやアウトプットの習慣を持つ:デジタルツールに頼りすぎず、メモを取る・手を動かして考える・議論するなどの習慣を持つことで、思考力や創造力を鍛えることができます。

- 意図的にAIを使わない時間を作る:AIのない環境で問題解決を試みたり、自分の頭でアイデアを練る時間を設けることで、思考力や創造性を鍛えることができます。

過信がもたらす思考力と創造性の低下は、私たちの日常はもちろんのこと、未来にも影響を与える重大な問題です。AIを活用する際には、その利便性だけでなく、私たち自身の能力をどう保ち、発展させていくかを常に意識する必要があります。

AIを正しく活用するために知っておきたい限界とリスク

AIは、情報収集やアイデアの創出に役立つ便利なツールですが、その回答をそのまま信じるのは危険です。AIは膨大なデータをもとに文章などを生成しますが、必ずしも正確で客観的な情報ばかりとは限りません。情報の誤りやバイアスに気をつけながら、AIを補助的に活用する方法を理解することが、より賢い情報活用につながります。

AIの限界を理解する

生成AIは、その利便性から多くのユーザーに利用されていますが、その回答をそのまま信じてしまう危険性が潜んでいます。AIはデータに基づいて情報を生成しますが、その情報が常に正確であるとは限りません。例えば、以下のような制限があります。

- 情報の「幻覚」(ハルシネーション)

AIは時折、実際には存在しない情報を作り出すことがあります。特に、専門的な分野では、もっともらしいが誤った情報を提示することがあり、これが誤解を生む原因になります。 - バイアスの影響

AIは訓練データに依存しているため、そのデータに含まれる偏りがそのまま出力に反映される可能性があります。その結果、特定の視点に偏った情報を提供したり、多様性に欠けた結論を出すことがありえます。 - 最新情報への対応遅れ

AIは過去のデータを学習しているため、リアルタイムでの変化に適応することが苦手です。法律の改正、社会情勢の変化、最新の研究成果などは、AIが適切に反映できていない可能性があるため、特に注意が必要です。 - 創造的思考の限界

AIは既存のデータを基に新しい組み合わせを生み出しますが、まったく新しい概念や独自の創造性を発揮することは苦手です。そのため、アートや哲学、最先端の科学分野においては、人間の直感やひらめきが依然として重要な役割を果たします。

批判的思考を促進する

生成AIの回答をそのまま受け入れるのではなく、批判的に考えることが重要です。以下の方法を意識することで、思考力を高め、誤った情報に惑わされない習慣を身につけましょう。

- 「なぜ?」を繰り返す習慣をつける

AIが出した回答に対して「本当にそうなのか?」「なぜこの結論が導かれたのか?」と疑問を持つ習慣をつけることで、情報を深く理解する力が身につきます。 - 情報源の確認を怠らない

AIが提供する情報が正しいかどうかを判断するために、信頼できる情報源を確認することが不可欠です。政府機関、専門家の論文、権威あるメディアなどを併用し、情報の裏付けを取るようにしましょう。 - 反証を探す習慣を持つ

AIが出した答えに対し、異なる意見や視点を意識的に探してみましょう。これにより、偏った情報に振り回されず、多角的な視点を持つことができます。 - 専門家の意見を取り入れる

特に重要な決定をする際には、専門家の意見やアドバイスを求めることで、より正確で信頼性の高い判断ができます。AIを参考にしつつ、人間の経験や知識を活かすことが大切です。

AIを補助的に使う

AIは情報収集やアイデアのインスピレーションを得るのには便利ですが、最終的な決定や判断は自分自身の知識と経験に基づいて行うことが重要です。AIを上手に活用するためのポイントを押さえましょう。

- AIと人間の役割を分ける

AIが得意なこと(データ処理やアイデアのブレインストーミング)と、人間が得意なこと(創造的思考、倫理的判断、共感を伴う対話)を明確に分けることで、AIを適切に活用できます。 - 情報を精査する

AIが提供した情報を鵜呑みにせず、正しいかどうかを検証する習慣を持ちましょう。これにより、思考力が鍛えられ、自らの知識も向上します。 - アウトプットを意識する

AIが提供する情報をただ受け取るだけでなく、それを基に自分で考え、発信する習慣をつけることで、情報をより深く理解し、独自の視点を持つことができます。 - 他者からのフィードバックを得る

自分の考えを他者と共有し、フィードバックを受けることで、視点が広がり、新たなアイデアを得ることができます。AIを活用する際も、常に人間同士のコミュニケーションを大切にしましょう。

AIに使われるのではなく、AIを使いこなす意識を持つ

AIは素晴らしい補助ツールですが、私たちが 「何を信じ、どう使うか」 を意識しなければ、思考力や創造性を失うリスクがあります。AIに頼るのではなく、AIを活用することが重要です。

つまり、AIに答えを求めるのではなく、AIの情報を参考にしつつ、自分で調べ、考え、判断することが必要です。

今後の情報社会においては、 「AIに使われるのではなく、AIを使いこなす」 というスタンスを持つことが、情報リテラシーの向上と個人の成長につながります。

AIは私たちの生活や仕事を支える強力なツールですが、それに頼りすぎることで思考力や創造性が損なわれるリスクもあります。AIを正しく活用するためには、その限界を理解し、批判的思考を持ち、自らの判断力を鍛えることが必要不可欠。

最も重要なのは、AIに答えを求めるのではなく、AIを活用しながら自分自身で答えを導き出すこと。 AIに依存するのではなく、あくまで補助的なツールとして使いこなす意識を持つことが、情報社会を生き抜くための鍵となります。

これからの時代、AIとどう向き合うかは私たち次第です。便利さに流されるのではなく、AIと適切な距離を保ちながら、自らの知性を磨き続けていきましょう。

人間らしさを失うリスクについて考える

近年、AIの進化に伴い、人間の思考や感情が影響を受ける可能性が高まっています。AIの利便性を享受する一方で、過度に依存することで失われるかもしれない「人間らしさ」について考えることが重要です。このセクションでは、AI依存によって生じるリスクを掘り下げ、どのように向き合うべきかを考察します。

AIによる感情の削減

AIはデータに基づいて判断を下し、時には人間の感情を模倣することもできますが、それはあくまでもプログラムされた結果です。AIに頼ることが増えると、人間本来の感情表現や共感力を軽視する傾向が生まれるかもしれません。

例えば、感情知能(Emotional Intelligence) は他者との深いつながりを築くために不可欠ですが、AIがその役割を担うようになると、人間同士のコミュニケーションにおける感情の重要性が薄れてしまう可能性があります。また、AIアシスタントやチャットボットとの対話が増えることで、リアルな人間関係を築く機会が減り、共感力や対人スキルが低下するリスク も指摘されています。

倫理観の希薄化

AIはデータに基づいて迅速な判断を下しますが、そこに倫理的な配慮が十分に組み込まれているとは限りません。AIに過度に頼ることで、人間の倫理的判断が希薄化する懸念があります。

例えば、AIが医療診断を行う際、患者の背景や価値観を考慮せず、データのみに基づいた判断を下す可能性 があります。これにより、患者の人間性や尊厳が軽んじられるリスクが生じます。また、企業の採用やローン審査などにAIが活用されるケースでは、データに基づく「最適解」を優先するあまり、個々の事情や人間的な判断が軽視される可能性 もあります。

判断能力の低下と依存症

人間は自ら考え、悩みながら成長する存在です。しかし、AIに依存しすぎることで、判断力や創造性が退化する可能性 があります。

例えば、検索エンジンやAIアシスタントに頼ることで、自ら情報を分析し、深く考える機会が減少してしまいます。若者がチャットボットや音声アシスタントを頻繁に使用することで、自分で問題を解決する力が育まれず、自己決定力や自尊心の低下につながるケースも考えられます。

また、常にAIの推奨を受け入れることで、「自分で決める」という意識が希薄になり、意志決定の主体性が失われるリスク もあります。

失われる多様性と独自性

AIは膨大なデータを分析し、最適な答えを導き出しますが、その過程で多様性や独自性が損なわれる可能性があります。

例えば、ニュースフィードのアルゴリズムやSNSのレコメンド機能により、自分の興味や過去の行動に基づいた情報ばかりが提供される状況が生まれています。これにより、視野が狭まり、異なる意見や価値観に触れる機会が減少してしまいます。

また、AIが特定のトレンドを反映してコンテンツを生成すると、創造的なアイデアや独自性が失われる可能性もあります。音楽やアートの分野では、AIが大量の作品を生成することで、人間が生み出すオリジナリティの価値が薄れるという指摘もあります。

社会全体でAIの提案をそのまま受け入れるようになると、文化や考え方が均質化し、多様な視点や個性が尊重されにくくなるリスクが高まるでしょう。

安全策としての自己反省

こうしたリスクに対抗するためには、AIの便利さを享受しながらも、自らの思考や判断を意識的に育てる姿勢が求められます。特に以下の点を意識することで、人間らしさを保ちながらAIと共存することが可能になります。

✅ 批判的思考を促進する

AIの情報をそのまま信じるのではなく、「なぜこの答えが導かれたのか?」と疑問を持ち、自らの視点で評価することが重要です。

✅ 感情と倫理を重視する

AIの提案だけでなく、人間の感情や倫理的判断を加味して考える習慣を持つことが大切です。機械的な判断ではなく、人としての温かみや価値観を大事にしましょう。

✅ 多様な意見を尊重する

AIの提供する情報が偏ることを防ぐために、意図的に異なる視点や経験を持つ人と交流し、さまざまな考えに触れる機会を増やしましょう。AIに頼るあまり、自分自身を見失わないよう心掛けることが、これからの時代において求められています。

AIと適切な距離感を保つことが未来への鍵

AIは私たちの生活を大きく変える強力なツールですが、過度な依存は人間の本質的な能力を損なう危険性をはらんでいます。感情や倫理観、判断力、多様性といった「人間らしさ」を守るためには、AIとの距離感を意識し、自らの考えを持ち続けることが大切です。

AIが生み出す情報や提案を盲信するのではなく、批判的に評価し、多様な意見に耳を傾ける姿勢を持つことが重要です。そして、AIの進化とともに、「人間だからこそできること」を見極めながら、自分自身の成長や学びを止めないことが、より良い未来を築く鍵となるでしょう。

AIに「任せる」のではなく、AIを「活用する」。

この意識を持つことが、AI時代を生きる私たちに求められる重要なスキルなのかもしれません。

AIと上手に付き合うためのバランス術

生成AIの急速な進化は、私たちの生活に多大な利便性をもたらしています。しかし、これに過度に依存すると、思考力や創造性の低下を招く恐れがあります。そのため、AIと上手に付き合うための戦略が求められます。本セクションでは、AIを活用しながらも自分の考える力を維持し、適切なバランスを取る方法を紹介します。

自分の思考を優先する

AIが提供する情報をそのまま受け入れるのではなく、自分で考える時間を確保することが重要です。以下の方法を意識すると、思考力を鍛えながらAIを有効に活用できます。

- 意識的なタイムアウト

AIが情報を提示したら、すぐに受け入れるのではなく、自分の考えを整理する時間を設けましょう。例えば、結論を出す前に数分間考えを巡らせたり、メモに書き出してみることで、より深い理解が得られます。 - 情報のクロスチェック

AIの出した答えが正確かどうかを判断するために、他の信頼できる情報源と照らし合わせる習慣をつけましょう。例えば、ニュースであれば複数のメディアを比較し、学術的な内容であれば専門書や論文を確認するなど、多角的な視点を持つことが大切です。

日常生活の中でのクリティカルシンキングの実践

日々の生活の中でも、批判的思考を鍛えることができます。以下のアプローチを取り入れてみましょう。

- 質問をする

AIの回答に対して「なぜ?」「どうして?」と問いかけ、自分なりに考えを深める習慣をつけましょう。ただ情報を受け取るだけでなく、別の視点からの考察を加えることで、より広い知識が得られます。 - 意見の交換

AIが提供した情報について、仲間や同僚とディスカッションする機会を持ちましょう。異なる意見を聞くことで、自分の視野を広げ、より多角的な考え方ができるようになります。

自律性を意識した依存のコントロール

AIツールは非常に便利ですが、過度な依存は避けるべきです。次のようなルールを設けることで、適切なバランスを保つことができます。

- 利用の制限

AIの使用目的を明確にし、必要な場面でのみ活用するようにしましょう。例えば、「情報収集のためだけに使う」「アイデアの補助として利用する」など、利用範囲を決めておくことで、依存を防ぐことができます。 - 非AIの手段を活用

手書きのノートを使ったり、思考マッピングを行ったりすることで、脳をより活性化させることができます。デジタルツールに頼らず、自分の手で考える時間を確保することも重要です。

職場でのバランスを取るための工夫

職場でAIツールを使用する際も、効率性と自律性のバランスを考えることが大切です。以下の工夫を取り入れることで、AIを賢く活用できます。

- 定期的なチームミーティング

AIを活用した業務の結果をチームで共有し、なぜそのような結論に至ったのかを議論する機会を持ちましょう。AIの提案を盲目的に受け入れるのではなく、人間同士で検証し、納得のいく結論を導くことが重要です。 - 問題解決シミュレーション

実際の課題に対し、AIの提案だけでなく、各メンバーのアイデアを取り入れて解決策を模索するプロジェクトを実施すると、思考力を維持しながらAIを活用できます。AIの回答と人間の意見を比較しながら、最適な答えを導き出す習慣をつけましょう。

まとめ

AIの進化は、私たちの生活や仕事のあり方を大きく変えています。その便利さと効率性は魅力的ですが、過度に依存すると、思考力や創造性、さらには人間らしさまで損なわれるリスクがあります。本記事では、AIとの適切な距離感を保ちながら、自律性と批判的思考を維持する方法について記載しました。

AIを活用していくことはこれからの時代避けられませんが、「AIに頼る」のではなく、「AIを使いこなす」意識を持つことが重要です。そのために、以下のような意識を持つことを心がけましょう。

✅ AIの回答をそのまま信じず、異なる視点を探す習慣をつける

✅ 自分の意見を形成する時間を意識的に確保する

✅ AIに頼る範囲を決め、必要以上に依存しない

✅ 対話や議論を通じて、人間同士の思考力を高める機会を持つ

これからの時代、AIリテラシーを高め、「人間だからこそできること」を大切にすることが、より良い未来を築くカギとなるでしょう。AIの力を活かしつつ、自分自身の能力を磨き続けていくことが、これからの情報社会に求められるスキルになってくると思われます。

人間、運動しないと筋肉が衰えてしまうように、脳もしっかりと考えて負荷を与えていかないと衰えるということですね。

よくある質問

AIを活用しながら、思考力を低下させないためにはどうすればよいですか?

AIの提案をそのまま受け入れるのではなく、自分の意見を形成する時間を意識的に確保することが重要です。具体的には、以下の方法が効果的です。

✅ AIが出した回答に対して「なぜ?」と疑問を持ち、別の視点から考える。

✅ AIの回答を参考にしつつ、自分の考えを整理するタイムアウトを設ける。

✅ 異なる意見を持つ人と議論し、思考を深める機会を持つ。

こうした習慣を取り入れることで、AIの利便性を活かしながら、思考力を維持・向上させることができます。

AIを使うことで創造性が失われることはありますか?

可能性はあります。AIは過去のデータをもとに最適な回答を導き出しますが、それは「すでに存在する知識やパターンの組み合わせ」に過ぎません。そのため、AIの提案に依存しすぎると、自分自身で新しいアイデアを生み出す機会が減ってしまうことがあります。

✅ 創造的な活動では、AIをアイデアの補助ツールとして使い、最終的な判断や編集は自分で行う。

✅ AIが提供する情報をもとに、自分独自の視点やオリジナルな発想を加える。

✅ まったくAIを使わない時間を意識的に作り、手書きやブレインストーミングを行う。

このように 「AIに頼る」のではなく、「AIを活用する」という意識を持つことが、創造性を維持するポイントです。

AIに依存しすぎると、どのようなリスクがありますか?

AI依存には、以下のようなリスクがあります。

✅ 思考力の低下 – AIの答えをそのまま受け入れることで、自分で考える力が衰えてしまう。

✅ 判断力の弱体化 – AIが決定を下すことが当たり前になると、自己決定力が失われる。

✅ 倫理的判断の希薄化 – AIの提案が必ずしも倫理的に正しいとは限らず、それを無批判に採用することで問題が生じる可能性がある。

✅ 多様性の欠如 – AIが提示する情報が一定のパターンに偏ることで、新しい視点や異なる意見に触れる機会が減る。

これを防ぐためには、「AIの提案を鵜呑みにせず、自分で検証し、判断する習慣を持つ」 ことが大切です。

AIと共存するために、今からできることはありますか?

はい。AIと適切な距離を保ちながら活用するためには、次のような行動を意識しましょう。

✅ AIの回答を鵜呑みにせず、異なる情報源と比較する。

✅ AIを補助ツールとして活用し、最終的な判断は自分で行う。

✅ AIに頼りすぎず、手書きやブレインストーミングなどのアナログな思考法も併用する。

✅ 定期的にAIを使わない時間を作り、自分の考えを深める機会を持つ。

このような工夫をすることで、AIを「使われるもの」ではなく、「使いこなすもの」として位置づけることができます。

.webp)